美 FDA 승인 AI 기기 24종 중 절반 이상, 환자 정보 누락

흑인·아시아인 오진 우려… 전문가들 “기기 성능 못 믿는다”

“사람마다 뇌가 다른데, 진단 기기는 왜 모두에게 똑같이 작동한다고 하죠?”

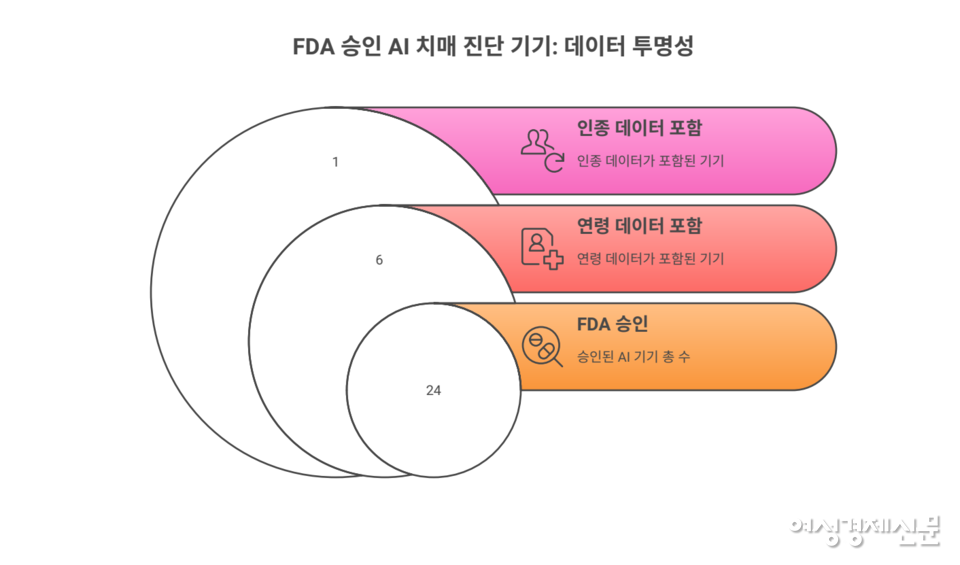

미국에서 지난 10년간 식품의약국(FDA) 승인을 받은 치매 진단용 인공지능(AI) 의료기기 24종 가운데 절반 이상이 정작 진단 정확도에 결정적인 인종·연령·성별 데이터를 제대로 공개하지 않은 것으로 드러났다. 진단 알고리즘의 편향(bias) 가능성이 제기되며 기술의 신뢰성과 형평성에 빨간불이 켜졌다.

4일 미국 의학저널 JAMA 최신호에 실린 일리노이대·예일대 공동 연구에 따르면 2015년부터 2024년까지 FDA 승인을 받은 AI 기반 치매 진단기기 24건 중 인종 정보가 포함된 경우는 단 한 건뿐이었다. 연령이나 성별도 절반 이상이 명시하지 않았다.

해당 기기들은 대부분 MRI 영상을 기반으로 환자의 뇌 구조를 수치화해 알츠하이머병이나 관련 치매(ADRD)를 조기 진단하는 기능을 갖췄다. FDA는 이 가운데 91.7%를 510(k) 일반 심사절차를 통해 비교적 빠르게 승인했다.

하지만 연구진이 각 기기의 승인 자료와 논문, 회사 홈페이지 등을 전수 분석한 결과, 훈련(training) 데이터의 연령 정보가 명시된 경우는 6건, 인종 정보는 단 1건에 그쳤다. 검증(validation) 데이터에서도 사정은 비슷했다. 다수의 기기에서 ‘누구를 대상으로 학습했는지’조차 확인할 수 없다는 것이다.

조셉 로스, 예일대 의과대학 교수는 여성경제신문과 통화에서 “진단 정확도보다 더 중요한 건 그 진단이 누구에게 유효하냐는 질문이다”라고 전했다.

FDA는 2021년부터 AI·ML 기반 의료기기에 대해 “훈련·검증 데이터에 인구통계적 대표성을 확보하라”는 가이드라인을 제시했고 올해엔 이를 의무화하는 초안 지침까지 마련했다. 이번 연구는 그런 권고가 현실에서 제대로 반영되지 않았음을 보여준다.

연구 책임자인 크리스타 첸 박사(일리노이대)도 여성경제신문과 통화에서 “기기 대부분이 백인 또는 특정 연령대에 편중돼 훈련됐을 가능성이 높다”며 “흑인, 라틴계, 아시아인 환자에게선 오진·과소진단 가능성이 커질 수 있다”고 지적했다.

치매는 조기 진단이 치료 계획의 핵심이다. 전문가들은 AI 기술의 도입 속도를 높이기 전에, 데이터의 투명성과 공정성 확보가 먼저라는 점을 강조한다.

한 국내 신경과 전문의는 여성경제신문에 “알고리즘이 누굴 기준으로 만들어졌는지 모르는 AI 진단기기는 일종의 ‘검은 상자(Black Box)’와 다를 바 없다”며 “AI 진단이 대세가 되기 전, 그 정확도와 편향 여부를 정밀히 검증할 필요가 있다”고 했다.

여성경제신문 김현우 기자 hyunoo9372@seoulmedia.co.kr